Wenn wir uns für politische Anliegen einsetzen wollen, zum Beispiel gegen Konzerne, die sich nicht um die Umwelt scheren, gegen eine immer faschistischere Welt, gegen Krieg und Despoten, dann tun wir das oft über Social Media. Plattformen wie TikTok strukturieren heute unsere Öffentlichkeit: Sie prägen, welche Themen sichtbar werden, wer gehört wird und wie politische Debatten stattfinden. Gerade für Aktivistinnen sind sie oft der wichtigste Kanal, um Aufmerksamkeit zu erzeugen, Unterstützer*innen zu mobilisieren und Gegenöffentlichkeiten zu schaffen. Das gilt besonders für marginalisierte Gruppen, etwa die palästinensische Diaspora, die digitale Räume nutzt, um Erfahrungen von Krieg, Vertreibung und Alltag sichtbar zu machen.

Doch dieses Versprechen von Sichtbarkeit ist ambivalent. Während Plattformen lange als Motor politischer Partizipation gefeiert wurden, zeigt sich heute ein deutlich kritischeres Bild. Dieselben Infrastrukturen, die Mobilisierung ermöglichen, fördern auch Überwachung, Depolitisierung und Repression. Plattformen sind keine neutralen Räume, sondern folgen kommerziellen Logiken, politischen Interessen und spezifischen Moderationsregimen. Und ein Blick auf ihre Besitzverhältnisse macht schnell deutlich, welchen politischen Agenden sie tendenziell näherstehen.

Vor diesem Hintergrund haben Sarah Häusermann und ich in unserem neusten Paper untersucht, wie pro-palästinensische Content Creator auf TikTok mit diesen Bedingungen umgehen. Dafür haben wir 13 Aktivist*innen interviewt, die regelmässig politische Inhalte posten. Unser Ziel war es, ihre Erfahrungen mit Content Moderation und insbesondere mit weniger sichtbaren Formen der Regulierung zu verstehen.

Die Ergebnisse zeigen ein klares Muster: Moderation findet zunehmend im Verborgenen statt. Der Fachbegriff dafür ist algorithmic visibility moderation: Inhalte werden nicht direkt entfernt, sondern stillschweigend in ihrer Reichweite begrenzt, etwa durch fehlende Ausspielung auf der „For You Page“. Diese Praxis wird oft als Shadowbanning beschrieben und bleibt intransparent und schwer nachweisbar.

Zentral ist dabei die Erfahrung von Intransparenz. Viele Interviewte berichten, dass Inhalte ohne klare Begründung entfernt oder eingeschränkt werden. Die Community Guidelines bieten wenig Orientierung. TikTok löscht, was politisch nicht passt. Das sind in diesem Kontext Perspektiven von Musliminnen, sowie anti-Israelische und antikoloniale Stimmen. Der Appeal-Prozess funktioniert dabei kaum: Selbst wenn Inhalte wiederhergestellt werden, erreichen sie oft nicht mehr ihr ursprüngliches Publikum (sie haben ihr Zeitfenster, um viral zu gehen, verpasst). Dadurch entsteht ein Gefühl von Ohnmacht und Kontrollverlust. Plattformen können so politische Sichtbarkeit beeinflussen, ohne dass Nutzerinnen genau verstehen, was passiert oder sich effektiv dagegen wehren können.

Diese Dynamik lässt sich mit dem Konzept des Platform Gaslighting beschreiben. Nutzerinnen werden dabei systematisch im Unklaren gelassen und beginnen, an ihren eigenen Einschätzungen zu zweifeln: War der Post wirklich problematisch? Habe ich etwas falsch gemacht? Muss ich meine Sprache anpassen? Statt strukturelle Probleme zu erkennen, wird Verantwortung individualisiert. Nutzerinnen werden so subtil in gewünschte Richtungen gelenkt.

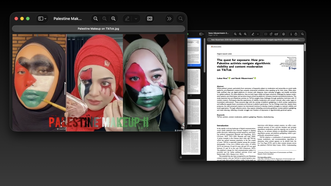

Gleichzeitig zeigen unsere Daten, dass Aktivist*innen nicht passiv bleiben. Sie entwickeln vielfältige Strategien, um Sichtbarkeit trotz dieser Bedingungen aufrechtzuerhalten. Dazu gehört etwa Algospeak, das bewusste Verändern von Begriffen oder das Nutzen von Emojis, um Moderationssysteme zu umgehen (z. B. die Wassermelone als Flagge) – oder das Einbetten politischer Inhalte in unterhaltsame, trendbasierte Formate (z. B. Make-up-Tutorials). Auch kollektive Praktiken spielen eine wichtige Rolle: Creator tauschen Wissen aus, unterstützen sich gegenseitig und koordinieren ihre Aktivitäten, um algorithmische Logiken gezielt zu nutzen.

Diese Strategien sind jedoch nicht für alle zugänglich. Unsere Stichprobe umfasst vergleichsweise etablierte Creator mit Erfahrung, grosser Reichweite und Netzwerken. Weniger sichtbare oder weniger vernetzte Stimmen fehlen möglicherweise bereits. Das ist ein klassischer Bias in der Forschung: Wir sehen vor allem diejenigen, die es trotz allem noch schaffen, sichtbar zu bleiben.

Der Fall pro-palästinensischer Aktivist*innen macht damit ein breiteres Problem sichtbar. Wenn Plattformen darüber entscheiden, welche Inhalte Reichweite erhalten und welche nicht, wird politische Sichtbarkeit selbst zur umkämpften Ressource. Dass diese Steuerung zunehmend im Hintergrund, ohne Kennzeichnung und ohne wirksame Einspruchsmöglichkeiten geschieht, sollte uns alarmieren.